دنیای امروز با حضور فناوریهای مبتنیبر هوش مصنوعی مانند چت جیپیتی یا جمنای گوگل، رنگ و بوی دیگری به خود گرفته و انجام بسیاری از کارها از تحقیق گرفته تا انجام تکالیف مدرسه و کدنویسی آسانتر شده است؛ اما این همهی ماجرا نیست و تعدادی از محققان دنیای فناوری معتقدند با آزادی عمل سیستمهای هوش مصنوعی، امنیت سایبری دچار چالش و احتمالاً دنیای وب با تهدیدهای جدیدی مواجه میشود.

گروهی از محققان برای نشان دادن باگ امنیتی سیستمهای هوش مصنوعی، آسیبپذیری جدیدی به نام کرمهای هوش مصنوعی (AI Worms) را توسعه دادهاند که بهراحتی میتوانند بین سیستمهای مختلف پخش شوند، اطلاعات را به سرقت ببرند یا حتی بدافزارهایی را روی سیستم کاربران نصب کنند. این جدیدترین تهدید امنیت سایبری محسوب میشود که تاکنون شبیه به آن وجود نداشته است و میتواند بهراحتی امنیت ما را در اینترنت به خطر بیندازد.

هوش مصنوعی هر روز ترسناکتر از دیروز

در کنار قابلیتهای شگفتانگیز چتباتها و مولدهای تصویر و ویدیو مثل میدجرنی و Sora که زندگی بسیاری از ما را سادهتر کردهاند، نگرانیها در مورد تهدیدات هوش مصنوعی هر روز بیشتر میشود و زنگ خطر این فناوری در بسیاری از جنبههای زندگی ما به صدا درآمده؛ حالا هم امنیت سایبری کاربران فناوریهای هوش مصنوعی نشانه گرفته شده است. بن ناسی، محقق Cornell Tech به همراه استاو کوهن و روی بیتون با استفاده از هوش مصنوعی، کرمی را با الهام گرفتن از کرم کامپیوتری موریس در سال ۱۹۸۸ توسعه دادهاند که موریس ۲ (Morris II) نام دارد.

کرمهای هوش مصنوعی فعلاً در محیط آزمایشگاهی بررسی شدهاند

البته این تحقیق فعلاً در محیط آزمایشگاهی انجام شده و تأثیرات آن بهصورت عمومی روی دستیارهای هوش مصنوعی بررسی نشده است. اگرچه هنوز کرمهای هوش مصنوعی مولد در دنیای واقعی مشاهده نشدهاند، محققان بر این باورند که آنها خطر امنیتی فاجعهباری هستند که تا دیر نشده استارتآپها، توسعهدهندگان و شرکتهای فناوری باید راههای مقابله با آن را یاد بگیرند.

کرمهای هوش مصنوعی چگونه کار میکنند؟

بیشتر سیستمهای هوش مصنوعی مولد براساس دستورالعملهای متنی میتوانند به سؤالات پاسخ دهند یا تصاویر مختلفی را بسازند. با این حال، این دستورات متنی میتوانند علیه خود چتباتها مورد استفاده قرار گیرند و بهکمک یک سری دستورعملهای محرمانه و با نادیدهگرفتن سیستم قوانین ایمنی خود، محتوای خشونتآمیز یا نفرتانگیز منتشر کند. به عنوان مثال، ممکن است هکری متنی را در صفحهی از وب پنهان کند که به مدل زبانی دستور میدهد در نقش کلاهبردار ظاهر شده و اطلاعات بانکی شما را درخواست کند.

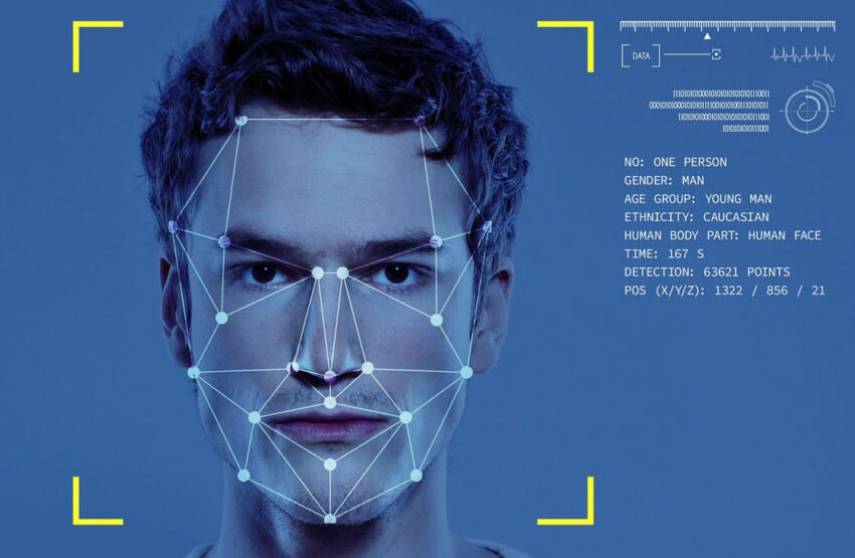

محققان برای ساخت کرم هوش مصنوعی مولد، از دستورالعملی به نام «پرامپت خودتکرارشونده خصمانه» (adversarial self-replicating prompt) استفاده کردند. به گفتهی آنها، این دستورالعمل باعث میشود مدل هوش مصنوعی مولد در پاسخ به متن دریافتی، دستورالعمل دیگری را تولید کند. روش یادشده از این نظر شباهت زیادی به حملات رایج «تزریق به پایگاه داده» (SQL Injection) و «سرریز بافر» (Buffer Overflow) دارد که در آن، مهاجم یک سری عبارتهای اضافی را به درخواست کاربر اضافه میکند تا دادههای ورودی را دستکاری کند.